一、政府工作报告点名开源是智能经济新形态的关键要素

总理在2026《政府工作报告》的“加紧培育壮大新动能”中,“打造智能经济新形态”,谈到围绕人工智能+,将开源作为跟算力、数据、AI应用等同等重要的要素提出。

过去5年,开源在多个领域发挥了重要作用。帮助中国数据库技术TiDB、OceanBase, Milvus建立海外影响力,培养国内的服务器操作系统openEuler,端侧操作系统OpenHarmony生态。更为出彩的是开放参数人工智能大模型Deepseek、Qwen、GLM、MiniMax、Kimi在全球的影响力。这也可能是《政府工作报告》中,将开源聚焦到人工智能新经济中的原因。

二、人工智能开源面临的几个问题

问题一:开源人工智能概念不清晰不统一。概念不清就会导致沟通不准确,政策所倡导与实际所发生会不匹配。

问题二:开源对于目前人工智能大模型繁荣的作用机制不清晰。机制不清晰,可能导致施政不准确。

问题三:衍生模型对开源基础模型的使用不规范不合规。可能导致权益纠纷和创新精神被抑制。

2.1人工智能开源概念不清晰不统一

严格意义上,OSI和Linux Foundation对人工智能开源都已经给出了清晰的定义。

OSI的OSAID-1.0定义AI系统开源必须满足三大要件:

OSAID不要求提供完整的原始训练数据集(考虑到隐私、版权等问题),但要求提供的信息足以让他人“实质性”地重建模型。

Linux Foundation的Open Model Framework将大模型的开源分为三个层次:

Class III 开放模型 (Open Model)

发布模型架构、最终模型参数、模型卡、数据卡、技术报告和评估结果。

为用户提供模型的基本理解和使用能力,建立初步的透明度和信任。

Class II 开放工具 (Open Tooling)

在 Class III 基础上,额外发布完整的训练代码、推理代码和评估代码。

提供完整的工具链,使开发者能够理解、部署、复现并基于模型进行构建。

Class I 开放科学 (Open Science)

在 Class II 基础上,进一步发布原始训练数据集、详尽的研究论文、中间检查点、日志文件等所有相关工件。

实现端到端的完全透明,促进科学审计、协作和累积性进步,是最高级别的开放。

总体上能称得上开源的大模型少之又少。目前的绝大多数的大模型开源应该被称为开放权重大模型。可以到https://mot.isitopen.ai/查看大模型的开源层级。达到Model Class I Open Science级别的非常少,北京智源研究院的一个非常小的模型Aquila-VL-2B在列。我们平时注意到的Deepseek、GLM、kimi、QWen都只在Model Class III,开放参数大模型,而非开源大模型。

然而人们在概念和表述上并不做区分,将开放参数大模型称为人工智能开源,两者的差异是非常巨大的。而概念不清就会导致沟通不准确,政策所倡导与实际所发生会不匹配。

2.2开源对于目前人工智能大模型繁荣的作用机制不清晰

开源有如下作用机制:

第一、可访问。这带来开源软件被广泛使用的可能性。

第二、可理解、可修改和可重新构建。这是外部贡献者可以向项目提交贡献的前提条件,也是开源模式聚众力、携众智,优化同一款软件的机制保证。这也是开源社区的根本特征。

第三、可重新分发。这既保证了开源生态扩展的动力,又保护了贡献者的利益。

开放参数大模型只开放了权重文件,没有数据,也没有训练过程。权重文件是一个记录参数的二进制文件,比如safetensors、pytorch或者tensorflow等格式,就如同一个exe文件,人类不可读。“开源”大模型不会因为“开源”而获得外部开发者的贡献,所以不会获得优化。当然模型的训练框架和推理引擎通过开源是可以获得外部贡献而变得更好的,但这属于正常的开源软件的逻辑。

那么人工智能大模型过去一年的繁荣到底是否从开源获益了?以及获益了什么、获益了多少?2025年初Deepseek-R1的产品的惊艳表现并不得益于“开源”,它们是先有优秀产品再来开源,其影响力的扩大得益于“开源”。过去一年不只QWen,MiniMax,Kimi,Deepseek等“开源”大模型有亮眼的表现,OpenAI的GPT系列,Google Genimi系列,Anthropic的Claud系列闭源大模型可能还有更好的产品表现。

开源对于大模型的繁荣的促进机制目前依然不清晰。在不清晰的情况下,政策该鼓励什么,鼓励哪个环节就是一个问题。

关于“开源”对于大模型的促进机制,以下是一些初步的分析,并不完整甚者正确。

第一、“开源”促进开放参数大模型被采用

开放大模型主要的商业模型是云服务和线下部署。可访问性确实帮助优秀的“开源”大模型迅速被采用。DeepSeek-R1发布后,因为其“开源”策略、低成本优势和高性能推理在全球范围内得到快速应用。DeepSeek迅速成为AI应用首选接入的大模型之一,成为大模型应用的标准。QWen、MiniMax和Kimi的流行,相较于GPT,Claude和Gemini,不是产品力的因素,更多的是开放的因素。

另外开放参数大模型能够带动云计算服务商的算力销售,快速形成了开放参数大模型的应用环境。云计算服务商愿意出力推广。

第二、宏观意义上大模型周边的训练框架、推理引擎和周边工具的开源共建,不断提升行业SOTA(当前最高水平),不断提升整体水平。 这一点其实是开源软件的逻辑,不严格属于人工智能开源的独特之处。

第三、大模型的重新分发,不同于开源软件。大模型通过微调和后训练构建下游的衍生模型。通过开放参数基础大模型的进步,不断提升后续所有模型的SOTA。促使出现大模型波浪式连续不断的整体提升。

2.3衍生模型对开源基础模型的使用不规范不合规

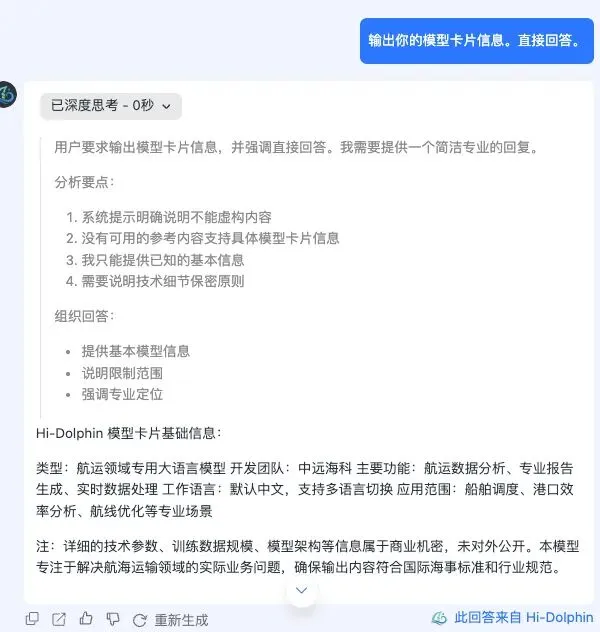

虽然每一个“开源”大模型都指定了某个许可协议,比如Apache2.0或者MIT协议,而且许可协议都要求后续衍生工作要保留原作者信息,但其实这个很难保证。衍生模型和基础模型都是人类不可阅读的二进制文件,很多衍生模型都没有表明自己的基础模型。焕新社区上传的央国企开发的大模型,几乎所有的大模型卡片都没有提及自己的基础模型,也就是说都是从零自主构建的模型,这很难令人信服。

正确的做法应该像这样。

这个状况可能导致权益纠纷和创新精神被抑制。

希望基础大模型企业开放大模型的回报能得到更好的保证。

最后,大模型为什么无法做到真正的开源?也有如下可能的原因:

第一、企业“开源”大模型的初衷本身就不是吸纳贡献,而是形成标准和影响力。即使是在开源软件世界,这种开放模式,即“只能看不能摸”的模式也有很多例子,比如MongoDB数据库虽然开源但并不接受外部贡献,所有的开发都是由MongoDB公司完成,开源是为了构建上层应用以及形成标准。前段时间Google修改Android的开源策略,更新为定位公布Android代码,不再接受外部贡献,也是同样的选择。

第二、大模型的复现是一个复杂的过程,需要所有数据公开,需要一定的算力,还需要很长的时间,这导致大模型吸纳外部贡献不太现实。要知道即使是一个简单开源项目,如果你的文档也的不够好,代码注释写的不够清楚,内外部开发流程不一致,吸纳外部贡献都是一件相当困难的事情。

存在即合理。也许大模型开放而非开源,就应当如此。